LLM 서빙이란 무엇인가?

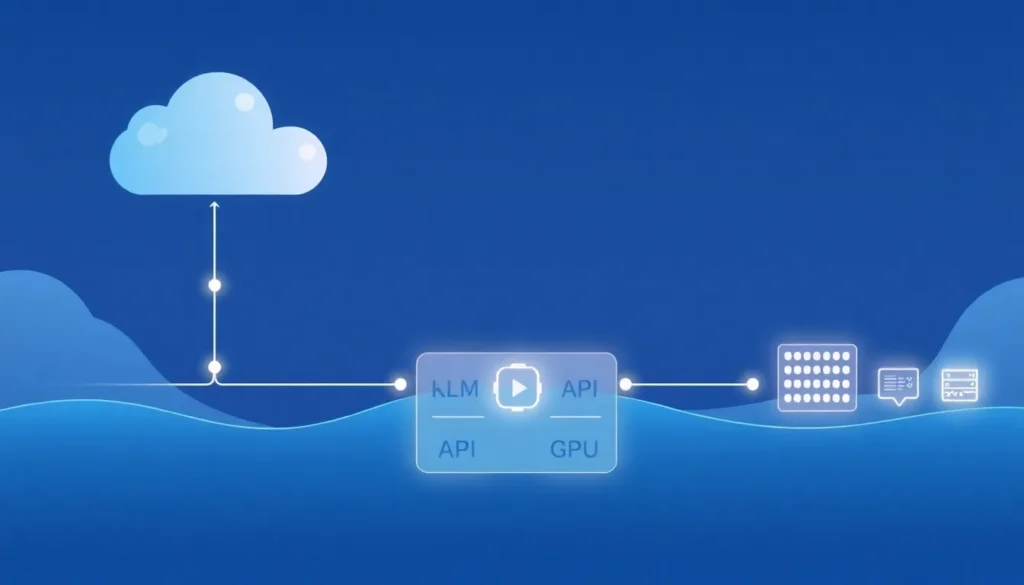

LLM은 거대한 언어 모델(Large Language Model)을 뜻하며, GPT, BERT 같은 인공지능 모델이 대표적이다. ‘서빙’은 이런 모델을 실제 사용자나 프로그램이 쓸 수 있게 인터넷이나 서버 위에서 제공하는 과정을 말한다. 즉, LLM 서빙은 대규모 언어 모델을 사용자에게 빠르고 안정적으로 응답하게 만드는 것이다.

모델이 커질수록 계산량과 처리 시간이 늘어나기 때문에, 최적화가 없으면 사용자가 느린 응답을 경험한다. 빠른 AI 서비스가 가능하려면 LLM 서빙 성능 최적화가 필수적이다.

성능 최적화가 중요한 이유

서비스 응답 속도가 느리면 사용자는 불편함을 느끼고 떠난다. 특히 AI 챗봇이나 추천 서비스처럼 즉각적인 대화가 필요한 곳에서는 성능의 중요성이 더욱 커진다. 또한, 서버 비용과 자원 낭비를 줄이기 위해서도 효율적인 서빙이 요구된다.

성능 최적화가 잘되면 빠른 응답 속도와 적은 자원 소모로 운영비용 절감 효과까지 볼 수 있다. 따라서 LLM 서빙 작업에서 성능을 높이는 것은 사용자 만족과 비용 관리 두 마리 토끼를 잡는 일이다.

LLM 서빙 성능 최적화의 핵심 요소

최적화를 위해 중요한 몇 가지 요소를 살펴보자. 첫째, 모델 경량화는 무거운 모델을 작고 빠르게 만들어 응답 속도를 높이는 기술이다. 둘째, 하드웨어 선택과 활용 방식이다. GPU나 TPU 같은 고성능 연산 장비를 적절히 사용해야 한다. 셋째, 요청 처리 병렬화로 여러 사용자 요청을 동시에 처리하는 방법도 성능 향상에 도움이 된다.

또한, 캐싱 기법을 통해 자주 쓰는 답변을 미리 저장하고 빠르게 전달하거나, 모델 프롬프트를 최적화하여 필요 이상의 계산을 줄이는 것도 좋은 방법이다. 마지막으로, 서버와 네트워크 구성 최적화도 무시할 수 없는 부분이다.

단계별 실행 방안

먼저, 서비스에 맞는 적절한 모델 크기를 선택하는 것이 중요하다. 너무 큰 모델은 느리고 비용도 많이 든다. 초반에는 중간 크기 모델을 선택하여 성능과 품질의 균형을 맞추는 것이 좋다.

다음으로, 모델 경량화 방법 중 하나인 지식 증류나 양자화 같은 기술을 학습하고 실제 적용해보자. 이를 통해 모델 크기를 줄이면서도 성능 저하를 최소화 할 수 있다.

하드웨어는 가용 자원 중 가장 좋은 연산 장비를 활용하되, 여러 대의 서버를 연결하는 병렬 처리 구조를 도입하면 응답 속도를 크게 향상시킬 수 있다. 병렬처리 환경 설정과 부하 분산을 위한 기본 개념부터 익히는 것이 필요하다.

또한, 캐시 시스템을 구축하여 동일하거나 비슷한 요청에 대해 빠르게 응답하도록 설계한다. 프롬프트 최적화 역시 간단한 문장 구조로 불필요한 연산을 줄이는 것을 목표로 한다.

마지막으로, 정기적으로 성능 모니터링 도구를 활용하여 처리 시간, 자원 사용률, 응답 성공률 등을 체크하고, 문제 발생 시 원인을 빠르게 찾아 해결하는 습관을 가지는 것이 좋다.

LLM 서빙 성능 최적화

LLM 서빙 성능 최적화는 처음에 복잡해 보여도, 개념을 하나씩 이해하고 차근차근 실행하면 충분히 달성할 수 있다. 모델 이해부터 시작해 하드웨어 활용, 병렬처리, 캐시, 프롬프트 최적화까지 단계별로 학습하면 된다.

성능 최적화는 단 한 번의 작업이 아닌 지속적인 노력과 모니터링이 필요하다. 꾸준히 시도하고 경험을 쌓으면 효과적인 LLM 서빙 환경을 구축할 수 있으므로, 한 걸음씩 도전해보자.